Texto a vídeo con IA: cómo funciona realmente la tecnología

La generación de vídeo a partir de descripciones textuales representa uno de los desafíos técnicos más complejos de la inteligencia artificial generativa. A diferencia de la generación de imágenes, que produce una sola composición estática, el vídeo requiere mantener coherencia visual a lo largo del tiempo, simular movimiento físicamente plausible y gestionar transiciones suaves entre fotogramas. Los avances recientes han hecho esta tecnología viable, pero el proceso subyacente es considerablemente más sofisticado de lo que muchos usuarios imaginan.

De texto a representación visual

El proceso comienza de forma similar a la generación de imágenes: un codificador de texto transforma el prompt en vectores semánticos que capturan el significado de la descripción. Sin embargo, para vídeo, el sistema también debe inferir información temporal que no está explícita en el texto: la velocidad del movimiento, la dirección de la cámara, la secuencia de eventos y la duración de cada acción. Los modelos más avanzados utilizan transformers especializados que entienden tanto el contenido espacial como la dinámica temporal.

Modelos de difusión temporal

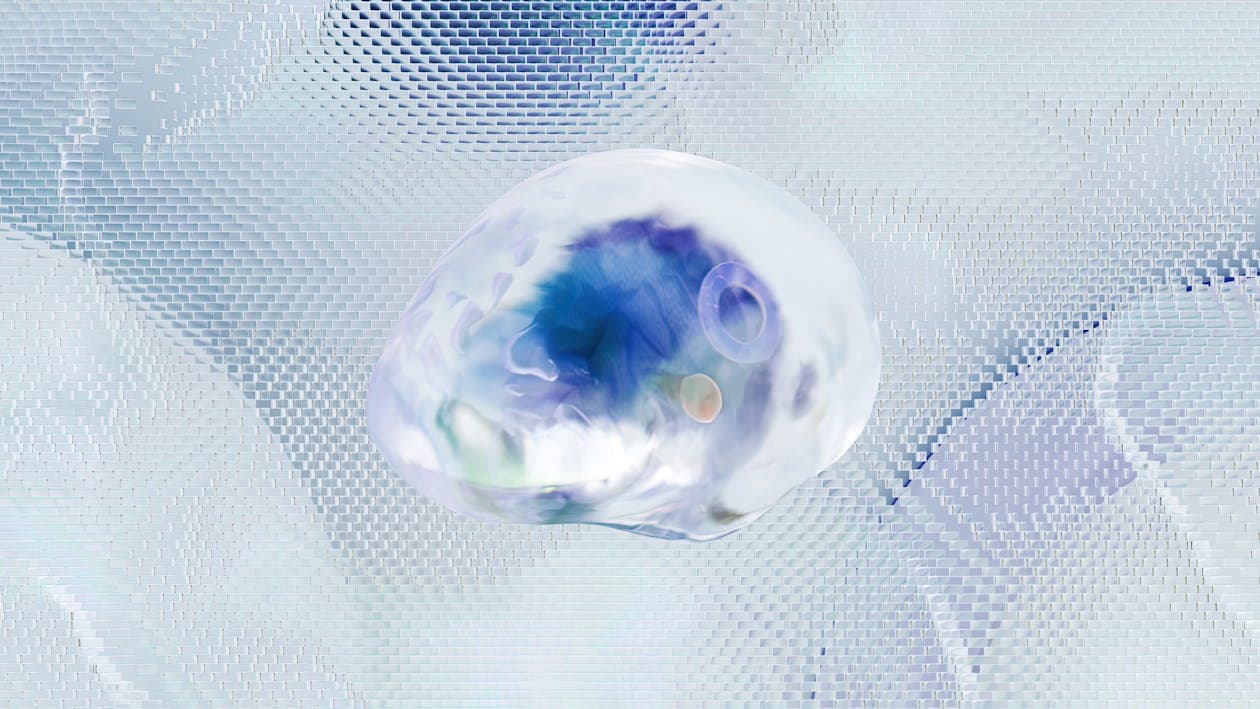

La arquitectura dominante para la generación de vídeo son los modelos de difusión extendidos al dominio temporal. En lugar de eliminar ruido de una sola imagen, estos modelos eliminan ruido de un volumen tridimensional que incluye las dimensiones espaciales (ancho y alto) y la dimensión temporal (los fotogramas sucesivos). Capas de atención temporal conectan los fotogramas entre sí, asegurando que el movimiento sea coherente y que los objetos mantengan su apariencia a lo largo del vídeo.

Coherencia temporal: el gran desafío

Mantener la coherencia entre fotogramas es el problema técnico más difícil de la generación de vídeo. Los objetos deben mantener su forma, color y posición relativa de un fotograma al siguiente. Las personas deben conservar su identidad facial y corporal durante todo el clip. El fondo debe permanecer estable mientras la cámara se mueve. Los fallos en la coherencia temporal producen parpadeos, deformaciones y cambios de apariencia que rompen la ilusión de vídeo real.

El estado actual y hacia dónde va

En 2026, los mejores modelos de texto a vídeo pueden generar clips de entre 5 y 60 segundos con resoluciones de hasta 1080p y coherencia temporal aceptable para muchos casos de uso. Las limitaciones principales son la duración máxima, la dificultad con escenas que involucran múltiples personajes interactuando, y la simulación de física compleja como fluidos o telas. Las investigaciones actuales se centran en extender la duración, mejorar el control creativo y reducir el coste de generación para hacer la tecnología más accesible.